Probablemente no te perdiste el anuncio del mes pasado sobre el generador de videos Sora de OpenAI. Creó un gran revuelo, generando tanto entusiasmo como tristeza, así como muchas preguntas dentro de la comunidad cinematográfica. Una de las cuestiones apremiantes que siempre surge cuando se habla de IA generativa es qué utilizan los desarrolladores de datos para el entrenamiento de modelos. En una entrevista reciente con The Wall Street Journal, la directora de tecnología (CTO) de OpenAI, Mira Murati, no quiso (o no pudo) dar la respuesta a esta pregunta. Agregó que no estaba segura de si Sora estaba entrenada en videos de YouTube o no. Esto plantea una pregunta importante: ¿Qué implica esto en términos de ética y concesión de licencias? ¡Echémosle un vistazo juntos!

En caso de que te lo hayas perdido: Sora es el generador de texto a video de OpenAI, que supuestamente es capaz de crear videoclips consistentes, realistas y detallados de hasta 60 segundos, basados en descripciones de texto simples. Aún no se ha hecho público, pero las presentaciones publicadas ya han provocado un intenso debate sobre el posible resultado. Una de las suposiciones es que podría reemplazar por completo el material de archivo. Otra es que a los creadores de vídeos les resultará difícil conseguir trabajos de cámara.

Si bien personalmente soy escéptico de que la IA pueda reemplazar por completo los trabajos creativos y cinematográficos, hay otra pregunta que me preocupa mucho más. Si usaran videos de YouTube para entrenamiento de modelos, ¿Cómo se les permitiría legalmente implementar Sora con fines comerciales? ¿Qué significaría en términos de licencias?

¿Sora fue entrenado en videos de YouTube?

Antes de la entrevista, Joanna Stern de The Wall Street Journal proporcionó a OpenAI una serie de indicaciones de texto que se utilizaron para generar videoclips. En la conversación con la CTO de OpenAi, Mira Murati, analizaron los resultados en términos de los puntos fuertes de Sora y sus limitaciones actuales. Lo que también se convirtió en el punto de interés de Joanna es cuán intensamente algunas de las producciones le recordaban a dibujos animados o películas conocidas.

¿Ha visto un modelo de algún vídeo de “Ferdinand” para saber cómo debería ser un toro en una tienda china? ¿Era fanático de “Bob Esponja”?

Joanna Stern, una cita de la entrevista del Wall Street Journal con Mira Murati

Sin embargo, cuando su entrevista abordó el conjunto de datos del que aprende Sora, Murati de repente dio marcha atrás y comenzó a tener dudas. No quería profundizar en los detalles, “no estaba segura” de si se utilizaron videos de YouTube, Facebook o Instagram en el entrenamiento del modelo de Sora, y se apoyó en la respuesta segura: “eran datos disponibles públicamente o con licencia” (¡que son dos cosas muy diferentes!). No es necesario ser un experto en lenguaje corporal para darse cuenta de que la CTO de OpenAI no se sentía cómodo respondiendo estas preguntas (puedes ver su reacción en la entrevista en video original a continuación, a partir del 04:05).

Desafíos de derechos de autor relacionados con la IA generativa

Según WSJ, después de la entrevista Mira Murati confirmó que Sora utilizó contenido de Shutterstock, con el que OpenAI tiene una asociación. Ahora bien, garantizaron que no es la única fuente de imágenes que los desarrolladores incorporaron a sus modelos de aprendizaje profundo.

Si analizamos la respuesta de Murati, la situación de los derechos de autor y la atribución se vuelve aún más crítica. La expresión “datos disponibles públicamente” puede significar que Sora de OpenAI rastrea todo Internet, incluyendo las publicaciones de YouTube y el contenido de las redes sociales. Los términos de licencia del contenido de YouTube, por ejemplo, no permiten este uso de todo el contenido que se encuentra allí.

Mantener los derechos de autor en línea es un área desafiante en sí misma. No soy abogado, pero algunas cosas son de sentido común. A modo de ejemplo, si Searchlight Pictures publica un tráiler de “Poor Things” en YouTube, esto no implica que se me permita utilizar libremente fragmentos del mismo en mi trabajo comercial (o incluso en mi blog, sin la atribución correcta). Al mismo tiempo, Sora de OpenAI tendrá acceso a él y podrá utilizarlo con fines de aprendizaje, pero también para sacar provecho de él.

Cómo reaccionan algunas empresas

El problema de los derechos de autor (y las licencias) con la IA generativa no es nuevo. Durante el año pasado, hemos oído hablar de un número cada vez mayor de demandas que grandes empresas de medios como “The New York Times” y “Getty Images” presentaron contra desarrolladores de IA (con frecuencia, contra OpenAI).

Si alguna vez has utilizado generadores de texto a imagen, seguramente habrás visto cómo la inteligencia artificial agrega palabras de aspecto extraño en las imágenes creadas. La mayoría de las veces recuerdan a una marca de agua de una imagen de archivo o al nombre de una empresa, lo que demuestra que estas empresas de IA no tienen derechos sobre todos los conjuntos de datos que utilizan.

Desafortunadamente, aún no existen regulaciones estrictas que les impidan a los desarrolladores de IA utilizar materiales en línea, por lo que descubrir y probar si se utilizó un dato en particular para entrenar el modelo, es casi imposible. Además de presentar demandas, algunas compañías han bloqueado el rastreador web de OpenAI para que no pueda seguir extrayendo contenidos de sus sitios, mientras que otras firman acuerdos de licencia (uno de los últimos ejemplos: Le Monde y Prisa Media, que traerá contenido en francés y español para ChatGPT). Pero, ¿qué haces como artista individual o creador de vídeos? Esta pregunta permanece abierta.

No revelar conjuntos de datos es un problema común para la IA generativa

No es sólo la CTO de OpenAI quien no quiere hablar sobre los conjuntos de datos para el aprendizaje de Sora. Por lo general, la empresa apenas menciona las fuentes que utiliza. Incluso en el documento técnico de Sora, solo se puede encontrar una nota: “entrenar sistemas de generación de texto a video requiere una gran cantidad de videos con los correspondientes subtítulos de texto”.

La misma cuestión problemática se aplica a otros desarrolladores de IA, especialmente a los que se autodenominan “pequeños”, “independientes” y/o “de investigación”. Por ejemplo, si echas un vistazo al sitio web del famoso generador de imágenes Midjourney e intentas encontrar información sobre los datos sobre cómo entrenan sus modelos, no tendrás suerte en tu búsqueda. La falta de transparencia en esta cuestión puede ser la primera señal de que estas empresas están intentando evitar problemas legales por el hecho de que no tienen derechos sobre los datos que utilizan.

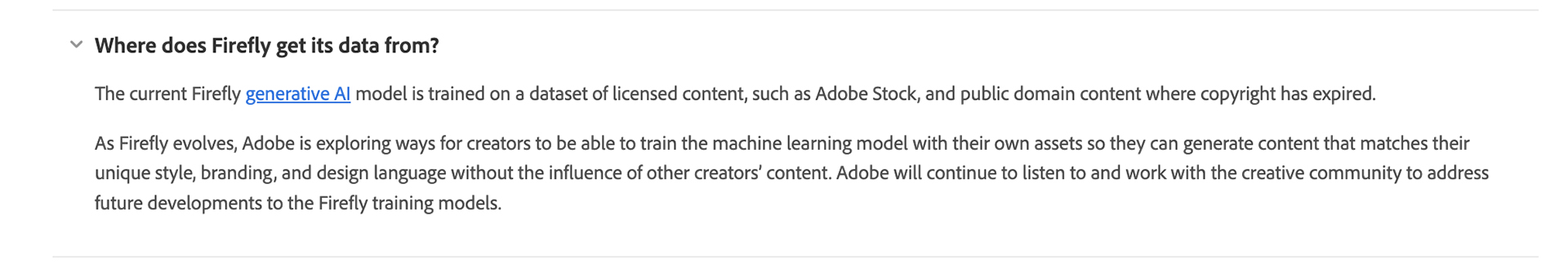

Lógicamente, hay excepciones. Así, Adobe, al lanzar su modelo generativo Firefly, abordó directamente la cuestión ética y publicó la información sobre los datos utilizados.

Sin embargo, su enfoque sigue siendo cuestionable. ¿Se les notificó a los colaboradores de Adobe Stock que sus imágenes se convertirían en el campo de entrenamiento para la IA? ¿Dieron su consentimiento? ¿Este hecho aumenta sus ganancias? Lo dudo.

¿Qué significa si Sora fue entrenado con videos de YouTube?

Como podrás ver, hemos llegado a una situación muy complicada sin soluciones claras a la vista. Durante la misma entrevista con el Wall Street Journal, Mira Murati mencionó que Sora sería dado a conocer al público este año. Según ella, OpenAI pretende que la herramienta esté disponible a costos similares a los de su generador de imágenes DALL-E 3 (actualmente cuesta alrededor de 0.080 dólares por imagen). De todos modos, si no encuentran una manera de aclarar sus datos de entrenamiento o compensar a los cineastas y creadores de videos, las cosas podrían ponerse muy tensas. Podemos predecir que al menos los grandes estudios, las productoras y los canales exitosos de YouTube dejarán atrás a OpenAI en demandas por derechos de autor si no resuelven esto por sí mismos, lo que podría ser difícil de hacer.

¿Qué opinas? ¿Cómo reaccionarías si la OpenAI confirmara directamente que utiliza vídeos de YouTube y todo el contenido publicado, independientemente de a quién pertenezca? ¿Hay alguna manera de que puedan hacer las cosas bien antes de lanzar Sora?

Fuente de la imagen destacada: una captura de pantalla del videoclip, generada por Sora de OpenAI.